研究生们还在绞尽脑汁写论文吗?AI能帮你写了

(图片来源:摄图网)

作者|碳中和产学研 来源|碳中和产学研(ID:carbonneutral_tech)

人工智能(AI)文本生成将从根本上改变科学出版。在过去的一年里,多个人工智能系统已经展示了视觉和文本内容的生产越来越难以与人类生成的工作区分开来,几乎在一夜之间为智力工作者创造了新的可能性,同时也引发了同样强烈的担忧。虽然艺术家和记者更明显地站在这场刚刚开始的革命的前沿,但不难想象,一位研究人员会看着一篇令人沮丧的稀疏的研究文章草稿,心想:“机器能帮我写吗?”

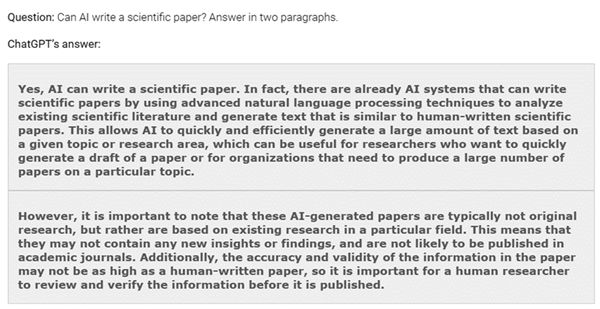

直到最近,这个问题可能还被认为是异想,因为机器生成的科学论点很容易与人类输出区分开来,而论文生成软件主要突出了同行评审过程对无意义论文的渗透性。然而,这些技术发展得如此之快,我们可能已经进入了一个新阶段,在这个阶段中,机器生成的文本可以无缝地集成到人工生成的科学文章中。为了更具体地说明这一点,剑桥大学的Grimaldi等人直接询问最近大火的ChatGPT:

这个结构合理的回答对作者的潜力和局限性提出了合理的观点。正如我们所写的,ChatGPT(人工智能生成文本,有人类监督)建议的“辅助驾驶”方法似乎被越来越多的研究人员所采用,有望将研究人员的时间从科学写作的负担中解放出来,让他们回到科学中。事实上,ChatGPT的回答显得保守,低估了人工智能在提供科学洞察力方面可能发挥的作用。人工智能语言模型能够考虑大量的科学文献,并将其浓缩成简明的块,研究人员可以使用人工智能语言模型来熟悉新的主题,并仔细检查文献概述的完整性。由于人工智能模型已经进入了科学文献搜索引擎,很容易想象它们演变成头脑风暴工具,利用它们广泛的文献知识,根据反复出现的科学主题提出建议。

此外,虽然目前的AI语言模型不能产生超出其训练集内容的语句,但我们应该问问自己,这是该技术的基本特征,还是只是暂时的限制。最近在复杂战略游戏中使用人工智能方面的突破,突显出人工智能在被认为是计算方法难以解决的问题上击败人类的惊人轻松。在使用人工智能促进科学进步方面的类似突破可能来自(i)精确的目标,即我们认为成功的科学观察的明确定义,(ii)能够有效优化这些目标的输出的算法,以及(iii)结构化和可访问的科学数据。在这种思路下,我们可以想象人工智能系统提出新的实验和对观察到的现象的新描述,并将数据以图表形式排列以支持其结论。一个能够产生原创科学作品的人工智能系统可能会给整个科学事业带来革命性的变化──例如,它可以不像人类那样受科学学科界限的束缚,将多学科科学推向新的高度。

然而,当我们沿着人工智能革命的斜坡迈出第一步时,有必要设想一下在底部等待我们的风险。

可能最直接的担忧是,当与先进的人工智能语言模型相结合时,三明治论文和论文制造工厂可能会变得超级强大。文本生成系统将实现速度与雄辩和结构化的语言相结合,可以使缺乏科学内容的科学论文的连续生产实现飞跃,增加论文制造工厂的产量,并使虚假研究的检测更加耗时。尽管缺乏成熟的方法,但这些做法的扩散已经对出版界产生了影响,如果人工智能加入战斗,这个问题可能会变得更糟。加大自动检测人工智能内容的力度可能会在解决这一问题上发挥重要作用。然而,很明显,这些方法需要对欺诈和合法使用人工智能内容建立明确的定义。人工智能已经可以写一些文章,在作者看来,这些文章可以通过同行对观点文章的评审。这种能力使得我们迫切需要在科学文献中使用人工智能生成的文本的行为准则变得非常清楚。

在更抽象的层面上,关于人工智能科学的原创性存在一些问题。人工智能生成的科学文本是原创的吗,尽管它是训练的产物,而不是人造的原创作品? 谁是内容的知识所有者? 这些问题与围绕人工智能创作艺术的持续辩论相呼应,并提出了关于谁将从人工智能知识生产中受益的类似担忧。如果一个人工智能系统能够从整个文献中收集信息,它是否能够将其结论追溯到最相关的科学工作并承认它? 或者,从非本地化的文献来源生产科学内容是否推动了一种新的范式,减少了对人类作者的重视?我们能否将目前基于个人贡献和知识产权从作者转移到期刊的科学出版模式直接应用到日益自动化的环境中?

人工智能自动化程度的提高还可能侵蚀写作风格的原创性,用同质化的风格取代人类作者的特质。个人风格特征的丧失,通常是文化的影响,是更接近相互理解的一步,还是一个期望的特征的去除? 这方面可能取决于人工智能系统在多大程度上对其训练内容进行“回归到均值”,从而平抑潜在有价值的偏差。管理内容生成中使用的随机性可能会提供防止人工智能产品同质化的方法,但这些系统是否可以复制人类科学家提供的声音和观点的多样性值得思考。

最后,关于人工智能在科学出版中整合的长期后果,值得考虑的是人工智能模型对偏差的脆弱性。人类研究人员远未摆脱偏见,但多种声音的存在有助于限制个人偏见的影响,作者身份的可追溯性使积极解决系统中的偏见成为可能。在科学生产中使用少量和多样化的人工智能系统有可能放大偏见的规模,在全球范围内有效传播它们,并避免通常用于识别这些偏见的个人审查机制。由于这些系统的行为很大程度上依赖于它们的训练,因此了解训练集的组成并确保它们不断更新所有可接受的科学生产形式是至关重要的。即使人工智能模型能够收集到所有可用的文献,他们将如何处理违背共识的报告?他们是否准备站在普遍持有的立场一边,对个别观点保持沉默? 最后,以人工智能为中心的科学内容生产系统是否容易受到恶意行为者的蓄意偏见?这些前景表明,至关重要的是要考虑并规范所使用的AI模型和训练集的开放性,并开始担心恶意策略的出现会放大所选观点的相关性。

其中一些担忧可能会通过小的调整来缓解,另一些可能需要系统性的改变,还有一些可能会促使我们限制这些新技术的使用。显然,人工智能将很快进入科学出版的实践,如果它还没有这样做的话(我们怎么知道呢?)这样做将显著而永久地改变科学。当计算机出现时,它们彻底改变了科学研究和交流的方式──这种变化需要调整和适应。先进人工智能的出现有望提高变化的程度,同时提高所需的适应程度。就像我们的住在森立里的祖先发现了火一样,我们需要注意我们令人兴奋的进步所带来的不良后果,以在不烧毁家园的情况下收获它们的好处。

编者按:本文转载自微信公众号:碳中和产学研(ID:carbonneutral_tech),作者:碳中和产学研

品牌、内容合作请点这里:寻求合作 ››

前瞻经济学人

专注于中国各行业市场分析、未来发展趋势等。扫一扫立即关注。